Fórum

- Community

- :

- Comunidade

- :

- Participe

- :

- Fórum

- :

- Publicação No Tableau Server

Publicação No Tableau Server

- Inscrever-se no RSS Feed

- Marcar tópico como novo

- Marcar tópico como lido

- Flutuar este Tópico do usuário atual

- Marcar como favorito

- Inscrever-se

- Emudecer

- Versão para impressão

- Marcar como novo

- Marcar como favorito

- Inscrever-se

- Emudecer

- Inscrever-se no RSS Feed

- Realçar

- Imprimir

- Notificar o moderador

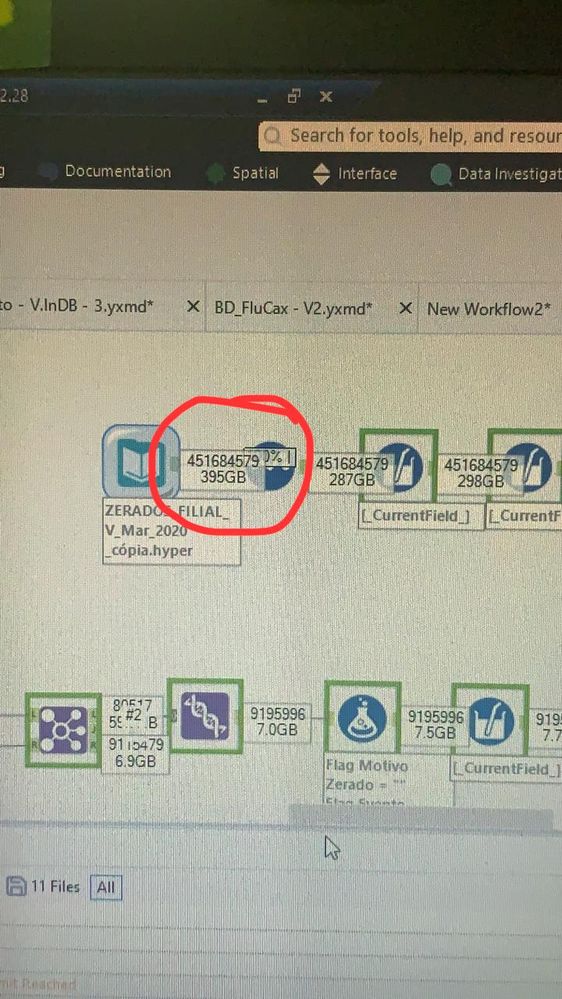

Estou há um tempo enfrentando a seguinte dificuldade: eu rodo um fluxo diariamente, o qual, publico os dados no Tableau server. No entanto, algumas vezes preciso reprocessar o histórico, seja para inclusão de novos campos ou para atualização daqueles existentes, mas quando extraio o hyper do tableau e insiro em um novo fluxo, o arquivo que tem 25GB, chega a crescer a mais de 400GB e desse modo, não consigo fazer a republicação. (Exemplo abaixo)

Os erros mais comuns são: #252 e #238.

Alguém sabe me ajudar com essa questão?

- Marcar como novo

- Marcar como favorito

- Inscrever-se

- Emudecer

- Inscrever-se no RSS Feed

- Realçar

- Imprimir

- Notificar o moderador

Olá Layane.

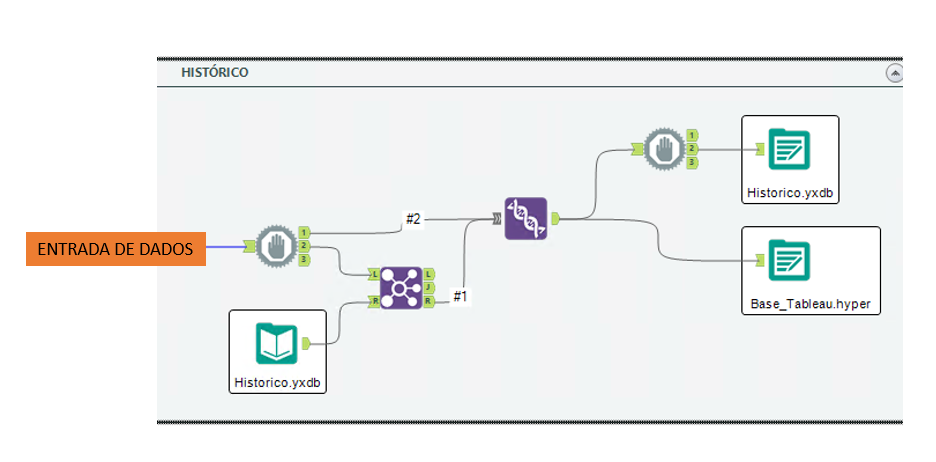

Eu utilizo sempre esse modelo para fazer histórico, é muito prático e fácil de se utilizar e fazer manutenção.

Se você utilizar datas como histórico, esse modelo irá funcionar bem.

MODELO EM PRODUÇÃO

Basicamente recebemos os dados e cruzamos com a base Histórico.yxdb, no meu caso eu utilizo datas como chave para o relacionamento.

Todas as datas que são encontradas na base Histórico.yxdb ficam no JOIN.

Na sequencia unimos o que está em execução com a saída R do relacionamento, que são os casos que não foram localizados na execução atual.

Em seguida a base é salva com o incremento do que estiver sendo executado.

Separadamente eu gero a Base_Tableau.hyper

O primeiro passo é criar a base inicial do histórico (de preferência e .yxdb visando a performance) para que ele possa nas próximas vezes consultar esta mesma base.

Espero que funcione pra você.

Até mais.

Thiago Belarmino

- Marcar como novo

- Marcar como favorito

- Inscrever-se

- Emudecer

- Inscrever-se no RSS Feed

- Realçar

- Imprimir

- Notificar o moderador

Obrigada pela ajuda, @thsoares_.

@LayaneCamara, nos avise se conseguiu dar uma olhada nas recomendações do Thiago e se ajudou com a sua questão.

-

2020

1 -

2023.1

1 -

2023.2

1 -

academia alteryx

2 -

ACE

1 -

ACE Program

1 -

ADAPT

1 -

Administração

2 -

Advent of Code

1 -

AiDIN

1 -

ajuda

12 -

Alteryx

11 -

alteryx core certification

1 -

Alteryx Designer

2 -

Alteryx Designer Expert

1 -

Alteryx Practice

2 -

Alteryx Server

2 -

alteryx simplifica

1 -

Alteryx team

1 -

AlteryxChat

1 -

Analytic Apps

1 -

Análise de Dados

2 -

análise preditiva

1 -

análise se dados

1 -

API

1 -

aplicativo

1 -

aplicativos

3 -

aplicação

1 -

aplicações analíticas

1 -

App Challenge

1 -

Banco de Dados

1 -

beta

1 -

Beta Program

1 -

Big Data

1 -

caso de uso

1 -

Certificacao

1 -

Certification

4 -

certificação

1 -

certificação alteryx core

1 -

certificação Core

3 -

cientista de dados

1 -

Cloud

1 -

Community

2 -

Comunidade

12 -

comunidade alteryx

1 -

configuração

3 -

Connect

1 -

contador de linhas

1 -

container

1 -

Core

1 -

core certification

2 -

core exam alteryx

1 -

Cross Tab

1 -

CSV

4 -

dados

2 -

Data Analysis

1 -

Data Analytics

1 -

Data Challenge

1 -

Data Investigation

1 -

Data Science Portal

1 -

datas

1 -

Designer

23 -

Designer Expert

1 -

Developer Tools

1 -

dicas

1 -

directoryinput

1 -

domínio de ferramentas

1 -

Download

1 -

Duvida sobre datas

1 -

dúvida sobre dados

11 -

E

1 -

em São

1 -

Email

2 -

Email Tool

1 -

emprego

1 -

encontrar e substituir

1 -

encontro

1 -

equipe Alteryx

5 -

erver

1 -

eventos

5 -

Events

1 -

exame

1 -

exame expert

1 -

Excel

5 -

Feedback

1 -

Find Replace

1 -

Fuzzy Match

1 -

Galeria

3 -

Gallery

1 -

Gallery API

1 -

Generative AI

1 -

Getting Started Learning Path

1 -

GRAFOS NO ALTERYX

1 -

Grand Prix

1 -

grupo de usuários

7 -

Guia de Estudo

2 -

Help

2 -

ideias

1 -

importação

1 -

infraestrutura

1 -

inputdata

1 -

Inspiração

1 -

Inspire

2 -

Installation

1 -

Intelligence Suite

1 -

Join

1 -

limpeza

1 -

Location Intelligence

1 -

luna

1 -

Macro

4 -

Macro batch

1 -

mensagem de erro

4 -

News

1 -

normalização

1 -

Notícias

1 -

Off-Topic

1 -

Optimization

1 -

Output Data

1 -

percentil

1 -

percentile

1 -

Performance

1 -

pipeline

1 -

políticas

1 -

portal de ciência de dados

1 -

PowerBi

1 -

Predictive Master

1 -

Predictive Modeling

1 -

preview

1 -

Promote

1 -

Public Sector

1 -

R Tool

1 -

referencia circular

1 -

RegEx

3 -

Resource

1 -

Santalytics

1 -

Search Feedback

1 -

Server

3 -

Servidor

1 -

SparkED

1 -

Spatial

2 -

SQL Server

1 -

São Paulo

5 -

São Paulo. Alteryx Server

1 -

tabela de referência cruzada

1 -

Teste

1 -

Thursday Thought

1 -

Topic of Interest

1 -

trabalho

1 -

Transformation

1 -

treinamento

1 -

truques

1 -

Twitter

1 -

user group

1 -

User Groups

2 -

vagas de emprego

2 -

vagas de trabalho

1 -

versão 2021.2

1 -

Virtual Global Inspire

1 -

web scraping

1 -

Webinar

2 -

Workflow

2 -

zip

1

- « Anterior

- Próximo »